Дипфейки та штучний інтелект: як сучасні технології обминають захист зображень.

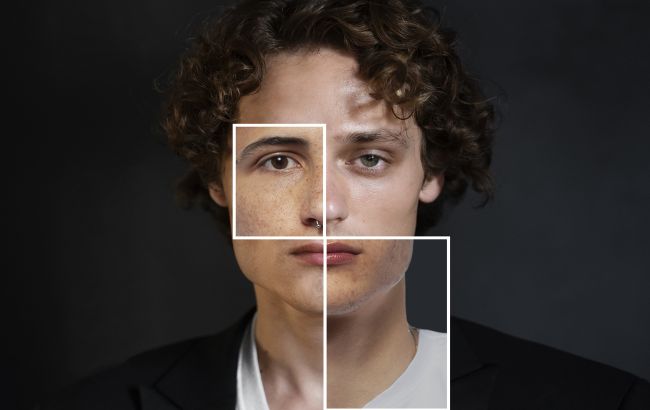

Дослідницька група під керівництвом експерта з кібербезпеки Бімала Вісваната з Virginia Tech виявила суттєві недоліки в сучасних методах захисту візуального контенту. Технології, які мали б перешкоджати зловмисникам використовувати фотографії для створення дипфейків або навчання штучного інтелекту, можна легко нейтралізувати.

Чому кіберзахист більше не є ефективним?

Раніше для обходу захисних фільтрів на зображеннях (так званого “захисного шуму”) зловмисникам були потрібні спеціалізовані знання та складні алгоритми. Нове дослідження довело: сьогодні для цього достатньо звичайних серійних моделей генеративного штучного інтелекту (off-the-shelf models) та простого текстового запиту.

Вчені протестували різні системи захисту, серед яких:

Семантичні спотворення: призначені для захисту ідентичності особи.

Невидимий шум: накладається через латентний простір штучного інтелекту;

Стійкий захист: спеціально розроблений для виживання під час додаткового навчання нейронних мереж.

Результати показали, що загальнодоступні моделі штучного інтелекту “image-to-image” не лише обходять ці перешкоди, але й роблять це ефективніше, ніж спеціалізовані хакерські атаки. При цьому зберігаються якість та корисність зображення для зловмисника.

Ілюзія безпеки?

Дослідники підкреслюють, що на сьогодні не існує математично гарантованого способу захистити публічні фотографії від копіювання сучасними генеративними моделями. Це створює серйозні ризики для цифрової приватності та автентичності контенту.

“Діючі методи безпеки надають користувачам оманливе відчуття захищеності”, – зазначає автор дослідження Бімал Вісванат.

На його думку, будь-яка майбутня технологія захисту повинна проходити стрес-тести саме за допомогою простих текстових атак через поширені моделі штучного інтелекту, а не лише через складне спеціалізоване програмне забезпечення.

Дослідження вчених підкреслює необхідність повного перегляду підходів до кібербезпеки в сфері візуальних даних. Оскільки генеративні моделі штучного інтелекту стають все більш потужними, створення надійного “щита” від несанкціонованого використання контенту стає дедалі складнішим завданням.

Вчені впевнені: сучасна ситуація вимагає нових стандартів перевірки стійкості захисту мультимедіа.